Codex, lo strumento per scrivere codice di OpenAI, introduce GPT-5.3-Codex-Spark, una versione ridotta e più leggera per un'inferenza ancora più rapida. Questo modello è infatti in grado di generare oltre 1000 token al secondo, con tempi dimezzati e interazioni immediate. Si basa sui sistemi CS-3 di Cerebras, con processore WSE-3 (ovvero Wafer Scale Engine 3). Vediamo meglio tutti i dettagli.

Come funziona

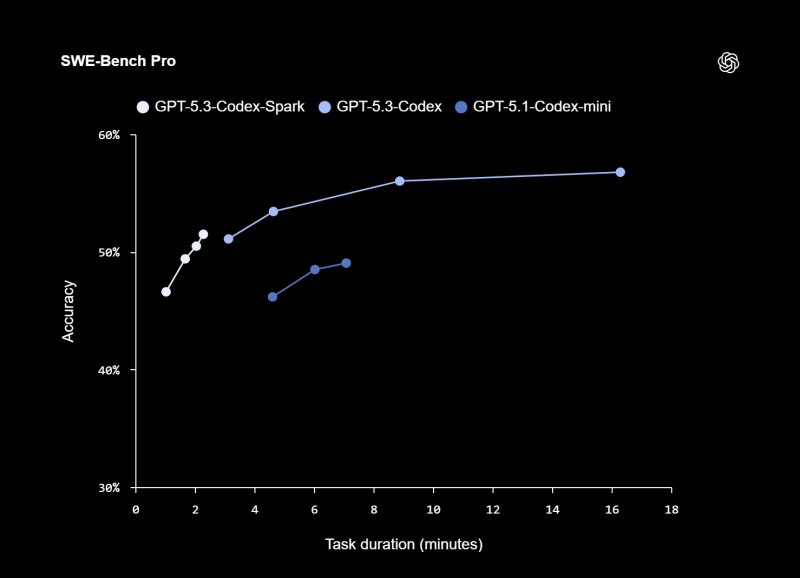

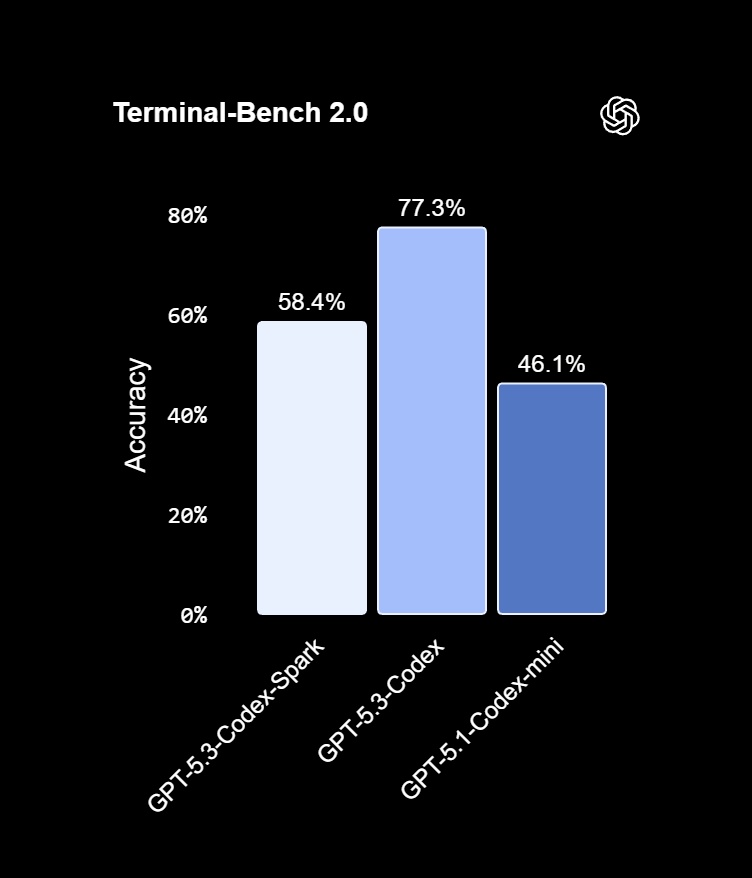

Come anticipato, Codex-Spark è ottimizzato per garantire una risposta quasi istantanea quando viene eseguito su hardware a bassa latenza. È in grado di fornire oltre 1000 token al secondo rimanendo altamente efficiente per le attività di codifica, ed è ottimizzato per lavori interattivi in cui la latenza gioca un ruolo cruciale. Proprio per questo motivo, Codex-Spark apporta modifiche minime e mirate, quindi non esegue automaticamente i test (a meno che non venga richiesto). Rispetto a GPT-5.3-Codex, e in base ai benchmark SWE-Bench Pro e Terminal-Bench 2.0, questo modello dimostra prestazioni elevate completando le attività in una frazione del tempo.

OpenAI ha implementato anche miglioramenti end-to-end della latenza ed è stato semplificato il modo in cui le risposte vengono trasmesse dal client al server e viceversa. Inoltre, è stato rielaborato il modo in cui vengono inizializzate le sessioni, affinché il primo token visibile appaia prima e Codex rimanga reattivo. L'overhead per roundtrip client/server è stato ridotto dell'80%, l'overhead per token del 30% e il tempo di attesa per il primo token del 50%. In base ai test, questo modello ha ottenuto un punteggio di accuratezza del 58,4%, posizionandosi sotto il 77,3% di GPT-5.3-Codex ma sopra il 46,1% della versione mini precedente.

Disponibilità

Attualmente è in fase di distribuzione in "research preview" per gli utenti di ChatGPT Pro nelle ultime versioni dell'app Codex, del CLI e dell'estensione per VS Code.

Inoltre, OpenAI sta rendendo Codex-Spark disponibile tramite API a un piccolo gruppo di utenti, in modo da capire come gli sviluppatori vogliono integrare il modello nei loro prodotti. L'accesso sarà esteso in modo completo nelle prossime settimane.

Per conoscere i dettagli della nostra policy editoriale, è disponibile la pagina etica.